【論文】PointGPT: Auto-regressively Generative Pre-training from Point Clouds

※ただの翻訳とポイントを書いたメモです。正確性は保証していません。

https://arxiv.org/pdf/2305.11487v2.pdf

アブスト

この論文では、PointGPTという新しい手法が提案されています。

点群(3Dデータの一種)に対するGPT(Generative Pre-training Transformer)の概念を拡張したもので、点群の無秩序な性質、情報密度の低さ、タスク間のギャップといった課題に取り組んでいます。

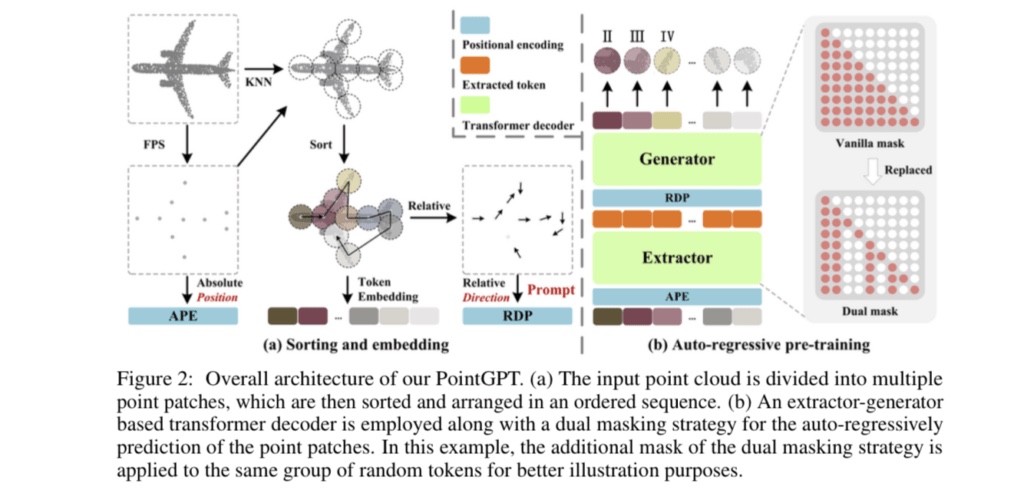

具体的には、点群の自己回帰生成タスクを提案し、トランスフォーマーモデルを事前学習します。この手法は、入力点群を複数の点パッチに分割し、それらを空間的近接性に基づいて順序付けたシーケンスに配置します。

その後、デュアルマスキング戦略を用いたエクストラクタ-ジェネレータベースのトランスフォーマーデコーダが、先行する点パッチに条件付けられた潜在表現を学習し、自己回帰的に次のパッチを予測します。

ポイント

このスケーラブルなアプローチは、高容量のモデルを学習し、さまざまな下流タスクで最先端の性能を達成することを可能にします。

- 点群に対するGPTの概念の拡張は、3Dデータの理解と分析に新たな可能性を開く可能性があります。これは、自動運転車やロボット工学など、3Dデータが重要な役割を果たす分野にとって特に重要です。

- PointGPTは、点群の無秩序な性質と情報密度の低さという、点群データ固有の課題に対処するための新しい手法を提供しています。これは、他のデータ形式(例えば、自然言語や画像)に対する既存のGPTモデルが直面する課題とは異なるものです。

- PointGPTは、自己回帰的な生成タスクを通じて、点群データから有用な表現を学習することができます。これは、教師なし学習の一形態であり、ラベル付けされたデータが不足している場合や、新しいタスクに対応するための迅速なモデルの適応が必要な場合に特に有用です。

- PointGPTのスケーラブルなアプローチは、大規模なデータセットから高容量のモデルを学習することを可能にします。これにより、さまざまな下流タスクで最先端の性能を達成することが可能になります。

ディスカッション

コメント一覧

まだ、コメントがありません